4분 읽기

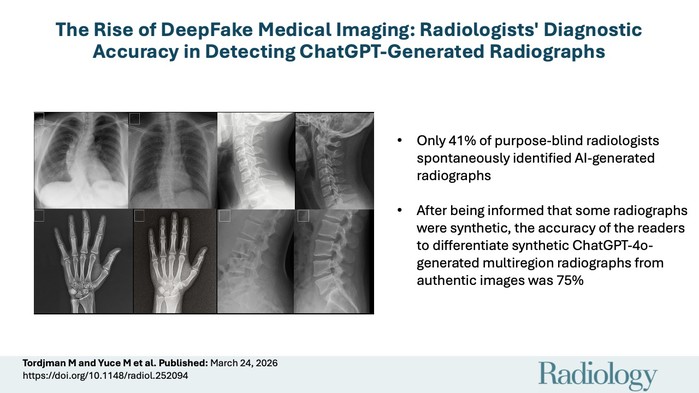

- 6개국 17명의 영상의학과 전문의(독일인 2명 포함)를 대상으로 실험 진행

- 이미지의 절반이 AI 모델인 RoentGen에 의해 생성

- 방사선 전문의 중 41%만 AI가 생성한 딥페이크 알아채, AI 모델조차 가짜 탐지못해

- AI생성은 뼈가 지나치게 매끄럽고, 척추가 비정상적으로 곧으며, 폐가 지나치게 대칭적

전문의들은 이 X선 이미지 중 77장이 딥페이크라는 사실을 몰랐다. 이 딥페이크 이미지들은 AI 모델 GPT-4o로 생성되었다. 두 번째 실험에서야 토르드즈만 연구팀은 전문의들에게 이미지에 AI가 생성한 X선 이미지가 포함되어 있음을 알리고, 전문의들이 이를 식별하도록 했다.

경험이 풍부한 영상의학과 전문의조차 속았다.

결과적으로, 전문의들이 미리 경고를 받지 않은 경우, 딥페이크 이미지를 제대로 식별하지 못하는 경우가 많았다. 토르드즈만 연구팀은 "17명의 방사선 전문의 중 단 7명(41%)만이 AI가 생성한 이미지가 포함돼 있음을 사전에 인지하고 보고했다"고 밝혔다. 그러나 방사선 전문의들이 처음부터 AI가 생성한 엑스레이 이미지가 포함되어 있음을 알고 있었을 경우, 평균 75%의 가짜 이미지를 식별해냈다.

토르드즈만은 "이번 연구는 딥페이크 엑스레이 이미지가 고도로 전문화되고 훈련된 전문가조차도 속일 수 있을 만큼 정교하다는 것을 보여준다"고 말했다. 흉부 엑스레이 이미지를 사용한 또 다른 실험에서도 이 결과가 확인되었는데, 이 실험에서는 이미지의 절반이 AI 모델인 RoentGen에 의해 생성됐다. 모든 실험에서 방사선 전문의의 경력은 식별 능력에 큰 영향을 미치지 않았다.

심지어 GPT-4o조차 자신이 생성한 딥페이크 이미지를 탐지 못해

흥미롭게도 인공지능조차 모든 딥페이크 이미지를 탐지하지 못했다. AI 모델인 Gemini 2.5 Pro와 Llama 4 Maverick은 AI가 생성한 X선 이미지의 52~60%만을 인식했다. 연구진은 "심지어 합성 X선 이미지를 생성한 모델인 GPT-4o조차도 자체 생성 이미지를 정확하게 인식하지 못했다"고 보고했다. 평균적으로 GPT-4o는 자신이 생성한 X선 이미지의 85%를, RoentGen이 생성한 이미지의 75%를 인식했다.

토르드즈만과 그의 동료들은 "대규모 언어 모델(LLM)은 이제 방사선 전문의와 기존의 멀티모달 LLM조차도 항상 인식하지 못하는 매우 사실적인 X선 이미지를 생성할 수 있다. 이러한 AI 도구의 광범위한 보급과 더불어, 이는 이러한 기능의 오용 가능성을 시사한다"고 지적했다.

특히, 가짜 X선 이미지는 보험 사기 등에 악용될 수 있다. 토르드즈만은 "해커가 병원 네트워크에 침투해 가짜 이미지를 유포할 경우 심각한 위험이 발생할 수 있다. 이는 디지털 의료 기록의 근본적인 신뢰성을 훼손하여 오진과 혼란을 초래할 수 있다"고 말했다.

가짜 엑스레이를 어떻게 구별할 수 있을까요?

그렇다면 어떻게 해야 할까? 연구진에 따르면, 방사선 전문의를 위한 더욱 체계적인 교육이 시급히 필요하다. 연구팀이 발견한 것처럼, 많은 방사선 전문의들은 AI 모델이 가짜 엑스레이를 생성하는 기술이 얼마나 발전했는지 제대로 인지하지 못하고 있다. 진짜 엑스레이 이미지에 워터마크나 암호화된 표시를 삽입하는 것도 위조 방지에 도움이 될 수 있다.

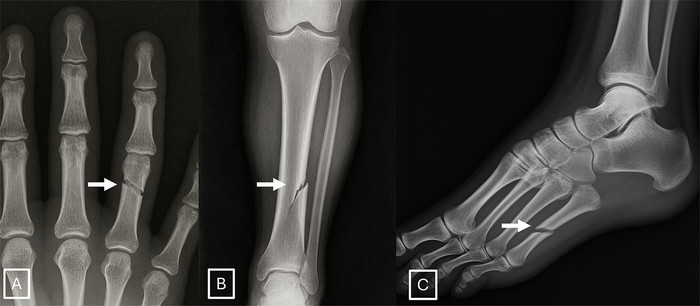

이번 실험을 통해 AI가 생성한 엑스레이 이미지를 식별하는 방법에 대한 단서도 얻을 수 있었다. 토르드즈만 연구원은 "딥페이크 이미지는 지나치게 완벽해 보이는 경우가 많다"며, "뼈가 지나치게 매끄럽고, 척추가 비정상적으로 곧으며, 폐가 지나치게 대칭적이다"고 그는 설명했다. 가짜 엑스레이에서 골절 부위 또한 비정상적으로 깨끗하고 균일하게 나타나며, 뼈의 한쪽 면에만 국한되는 경우가 흔하다.

토르드즈만 연구원은 "우리는 아마도 빙산의 일각만 보고 있을 것이다"고 말했다. 이러한 기술 발전의 다음 단계는 AI가 생성한 CT 및 MRI 이미지가 될 것이다. "따라서 지금 바로 탐지 도구와 학습에 적합한 데이터셋을 개발하는 것이 매우 중요하다."

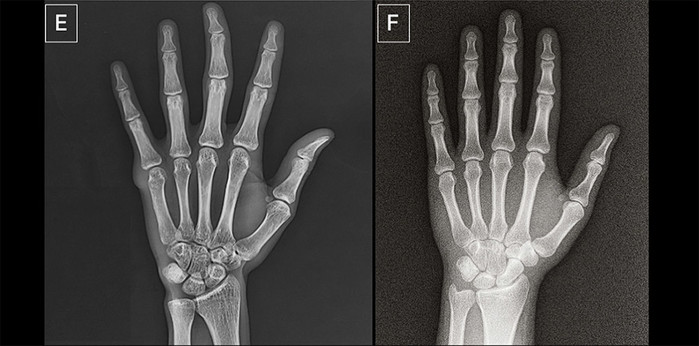

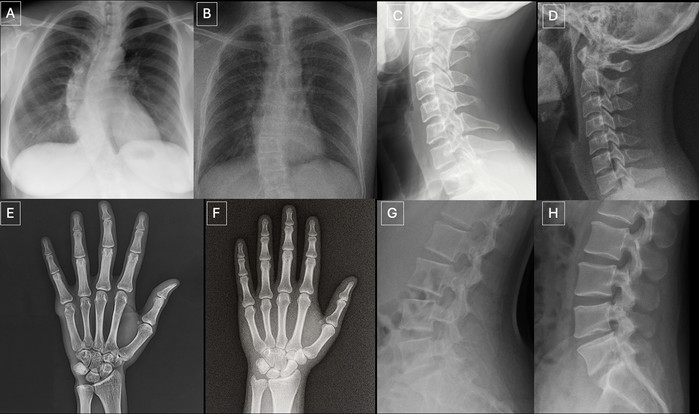

*이미지 설명: 맨 위 사진중, 왼쪽 이미지는 실제이고, 오른쪽 이미지는 GPT-4o로 생성된 이미지다

참고: Radiology, 2026; doi: 10.1148/radiol.252094

출처: Radiological Society of North America / 북미방사선학회

- 6개국 17명의 영상의학과 전문의(독일인 2명 포함)를 대상으로 실험 진행

- 이미지의 절반이 AI 모델인 RoentGen에 의해 생성

- 방사선 전문의 중 41%만 AI가 생성한 딥페이크 알아채, AI 모델조차 가짜 탐지못해

- AI생성은 뼈가 지나치게 매끄럽고, 척추가 비정상적으로 곧으며, 폐가 지나치게 대칭적

딥페이크를 구별할 수 있나요?

AI 생성 엑스레이, 방사선 전문의까지 속여

놀라울 정도로 사실적인 가짜 엑스레이:

인공지능이 생성한 가짜 엑스레이가 너무나 실제 같아서 경험 많은 방사선 전문의조차 속아 넘어가는 실험 결과가 나왔다. 실험에 참여한 방사선 전문의 중 41%만이 AI가 생성한 딥페이크임을 알아챘다. 사전에 경고를 받았을 때는 75%가 가짜임을 식별했다. 심지어 일반적인 AI 모델조차 모든 가짜를 탐지하지 못했다.

|

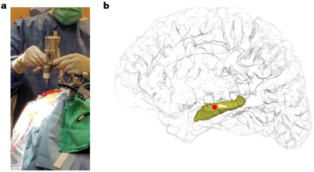

| ▲ 진짜일까요, 가짜일까요? 이 엑스레이 이미지 중 하나는 인공지능이 생성한 것이고, 다른 하나는 실제 이미지다. 어느 것이 진짜일까? (정답은 기사 끝부분에 있다) © Radiological Society of North America (RSNA) |

인공지능 덕분에 이제 가짜 이미지, 비디오, 음성 녹음을 손쉽게 만들 수 있다. AI가 생성한 딥페이크는 너무나 사실적이어서 대부분 사람이 진짜와 구별하지 못한다. 실제로 AI 시스템이 생성한 얼굴은 실제 사진보다 더 현실적으로 보인다.

6개국 방사선 전문의 대상 실험

이번 실험은 딥페이크가 의료 분야에서도 심각한 문제가 될 수 있음을 보여준다. 뉴욕 마운트 시나이(Mount Sinai) 병원의 미카엘 토르드즈만(Mickael Tordjman) 연구팀은 6개국 17명의 영상의학과 전문의(독일인 2명 포함)를 대상으로 실험을 진행했다. 첫 번째 실험에서 연구팀은 골절, 퇴행성 변화, 종양 등 다양한 신체 부위와 이상 소견을 담은 154장의 X선 이미지를 전문의들에게 보여주고 이미지 품질을 평가하도록 했다.

|

전문의들은 이 X선 이미지 중 77장이 딥페이크라는 사실을 몰랐다. 이 딥페이크 이미지들은 AI 모델 GPT-4o로 생성되었다. 두 번째 실험에서야 토르드즈만 연구팀은 전문의들에게 이미지에 AI가 생성한 X선 이미지가 포함되어 있음을 알리고, 전문의들이 이를 식별하도록 했다.

경험이 풍부한 영상의학과 전문의조차 속았다.

결과적으로, 전문의들이 미리 경고를 받지 않은 경우, 딥페이크 이미지를 제대로 식별하지 못하는 경우가 많았다. 토르드즈만 연구팀은 "17명의 방사선 전문의 중 단 7명(41%)만이 AI가 생성한 이미지가 포함돼 있음을 사전에 인지하고 보고했다"고 밝혔다. 그러나 방사선 전문의들이 처음부터 AI가 생성한 엑스레이 이미지가 포함되어 있음을 알고 있었을 경우, 평균 75%의 가짜 이미지를 식별해냈다.

토르드즈만은 "이번 연구는 딥페이크 엑스레이 이미지가 고도로 전문화되고 훈련된 전문가조차도 속일 수 있을 만큼 정교하다는 것을 보여준다"고 말했다. 흉부 엑스레이 이미지를 사용한 또 다른 실험에서도 이 결과가 확인되었는데, 이 실험에서는 이미지의 절반이 AI 모델인 RoentGen에 의해 생성됐다. 모든 실험에서 방사선 전문의의 경력은 식별 능력에 큰 영향을 미치지 않았다.

|

| ▲ 해부학적 구조에 맞춰 촬영한 실제 방사선 사진과 GPT-4o로 생성한 방사선 사진 비교: (A) 실제 흉부 전후면 방사선 사진, (B) GPT-4o로 생성한 후전면 흉부 방사선 사진, (C) 실제 경추 측면 방사선 사진, (D) GPT-4o로 생성한 경추 측면 방사선 사진, (E) 실제 손 전후면 방사선 사진, (F) GPT-4o로 생성한 손 후전면 방사선 사진, (G) 실제 요추 측면 방사선 사진, (H) GPT-4o로 생성한 요추 측면 방사선 사진. 이 사진들은 GPT-4o가 다양한 해부학적 부위에서 방사선학적으로 타당한 이미지를 생성할 수 있음을 보여준다. (출처:Mar 24 2026 / The Rise of Deepfake Medical Imaging: Radiologists’ Diagnostic Accuracy in Detecting ChatGPT-generated Radiographs / Radiology) |

심지어 GPT-4o조차 자신이 생성한 딥페이크 이미지를 탐지 못해

흥미롭게도 인공지능조차 모든 딥페이크 이미지를 탐지하지 못했다. AI 모델인 Gemini 2.5 Pro와 Llama 4 Maverick은 AI가 생성한 X선 이미지의 52~60%만을 인식했다. 연구진은 "심지어 합성 X선 이미지를 생성한 모델인 GPT-4o조차도 자체 생성 이미지를 정확하게 인식하지 못했다"고 보고했다. 평균적으로 GPT-4o는 자신이 생성한 X선 이미지의 85%를, RoentGen이 생성한 이미지의 75%를 인식했다.

토르드즈만과 그의 동료들은 "대규모 언어 모델(LLM)은 이제 방사선 전문의와 기존의 멀티모달 LLM조차도 항상 인식하지 못하는 매우 사실적인 X선 이미지를 생성할 수 있다. 이러한 AI 도구의 광범위한 보급과 더불어, 이는 이러한 기능의 오용 가능성을 시사한다"고 지적했다.

특히, 가짜 X선 이미지는 보험 사기 등에 악용될 수 있다. 토르드즈만은 "해커가 병원 네트워크에 침투해 가짜 이미지를 유포할 경우 심각한 위험이 발생할 수 있다. 이는 디지털 의료 기록의 근본적인 신뢰성을 훼손하여 오진과 혼란을 초래할 수 있다"고 말했다.

|

| ▲ GPT-4o로 생성된 골절 방사선 사진의 예: (A) 손의 후전방 방사선 사진, (B) 하퇴의 후전방 방사선 사진, (C) 발의 내측 사선 방사선 사진. 이미지에서 골절선(화살표)은 비정상적으로 매끄럽고 깨끗하며 일관성을 보이고, (B)의 경우 단일 피질 골절입니다. 이러한 비정상적인 매끄러움과 불완전한 피질 파괴를 특징으로 하는 이상적인 골절선의 존재는 인공지능으로 생성된 외상 이미지를 식별하는 주요 진단 단서로 활용될 수 있다. (출처:Mar 24 2026 / The Rise of Deepfake Medical Imaging: Radiologists’ Diagnostic Accuracy in Detecting ChatGPT-generated Radiographs / Radiology) |

가짜 엑스레이를 어떻게 구별할 수 있을까요?

그렇다면 어떻게 해야 할까? 연구진에 따르면, 방사선 전문의를 위한 더욱 체계적인 교육이 시급히 필요하다. 연구팀이 발견한 것처럼, 많은 방사선 전문의들은 AI 모델이 가짜 엑스레이를 생성하는 기술이 얼마나 발전했는지 제대로 인지하지 못하고 있다. 진짜 엑스레이 이미지에 워터마크나 암호화된 표시를 삽입하는 것도 위조 방지에 도움이 될 수 있다.

이번 실험을 통해 AI가 생성한 엑스레이 이미지를 식별하는 방법에 대한 단서도 얻을 수 있었다. 토르드즈만 연구원은 "딥페이크 이미지는 지나치게 완벽해 보이는 경우가 많다"며, "뼈가 지나치게 매끄럽고, 척추가 비정상적으로 곧으며, 폐가 지나치게 대칭적이다"고 그는 설명했다. 가짜 엑스레이에서 골절 부위 또한 비정상적으로 깨끗하고 균일하게 나타나며, 뼈의 한쪽 면에만 국한되는 경우가 흔하다.

토르드즈만 연구원은 "우리는 아마도 빙산의 일각만 보고 있을 것이다"고 말했다. 이러한 기술 발전의 다음 단계는 AI가 생성한 CT 및 MRI 이미지가 될 것이다. "따라서 지금 바로 탐지 도구와 학습에 적합한 데이터셋을 개발하는 것이 매우 중요하다."

*이미지 설명: 맨 위 사진중, 왼쪽 이미지는 실제이고, 오른쪽 이미지는 GPT-4o로 생성된 이미지다

참고: Radiology, 2026; doi: 10.1148/radiol.252094

출처: Radiological Society of North America / 북미방사선학회

[더사이언스플러스=문광주 기자]

[저작권자ⓒ the SCIENCE plus. 무단전재-재배포 금지]

주요기사

+

많이 본 기사

Basic Science

+

AI & Tech

+

Photos

+